Google Fotos: Gesichtserkennung ohne Gesichter – die Algorithmen erkennen Personen jetzt auch von hinten

Die Fotoplattform Google Fotos verfügt seit jeher über eine starke Gesichtserkennung, mit der die allermeisten Personen eindeutig zugeordnet werden können, selbst wenn das Gesicht nicht deutlich zu sehen ist. Jetzt hat es offenbar ein Update gegeben, bei dem das Gesicht zwangsläufig gar nicht mehr sichtbar sein muss, denn es kann Personen auch von hinten (!) erkennen. Dafür kommen anderen Merkmale zum Einsatz.

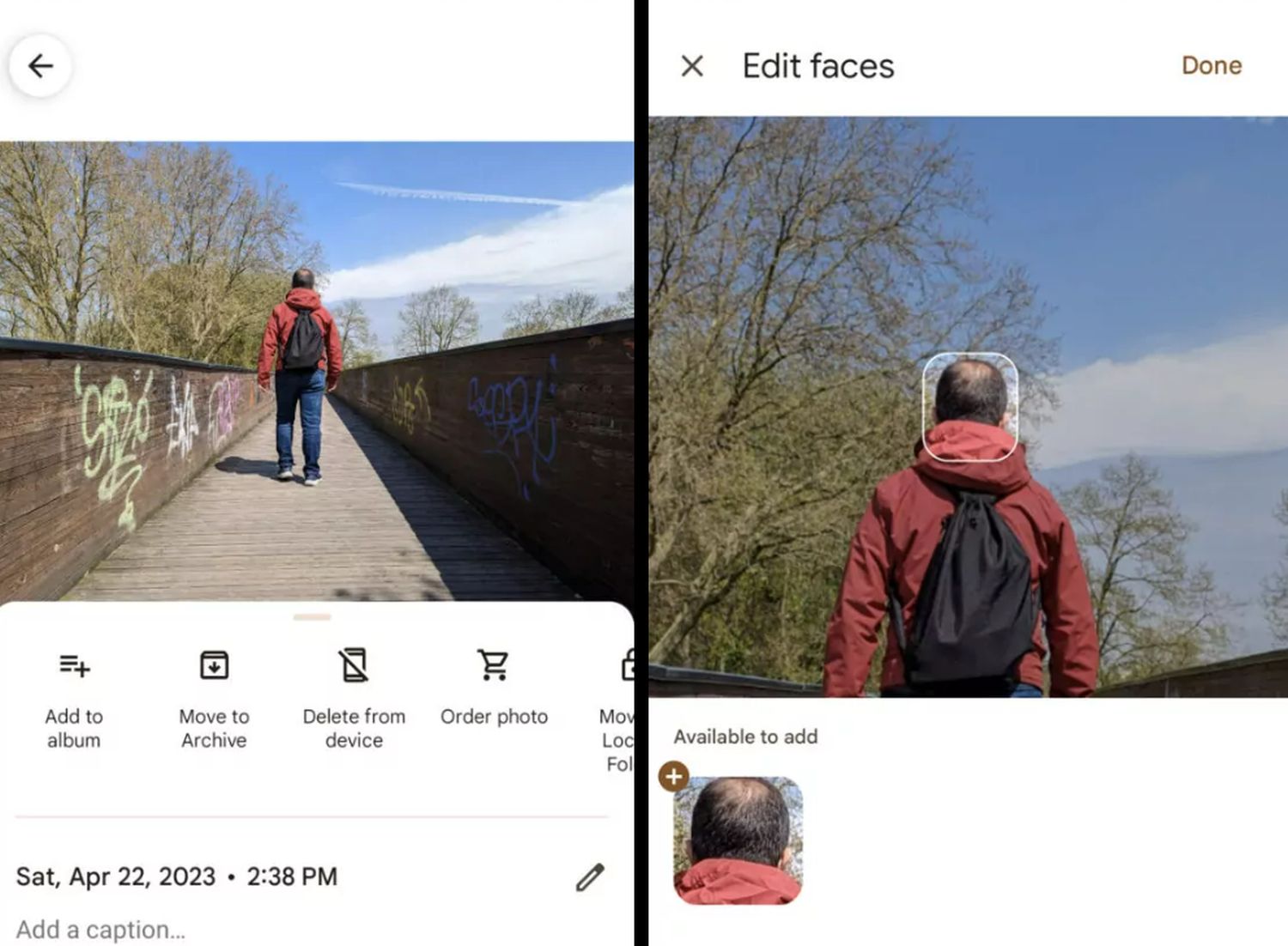

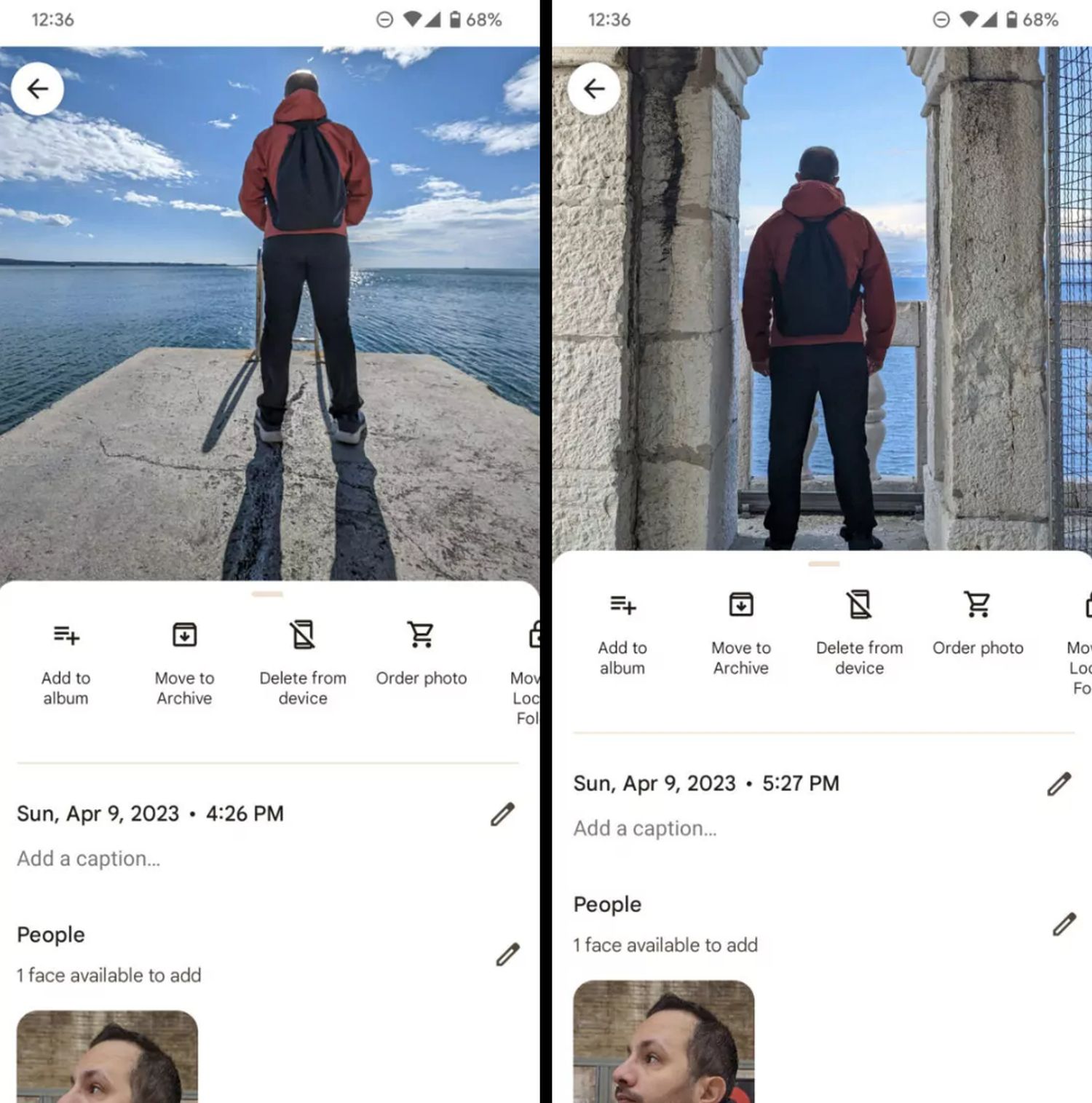

Auf die Google Fotos Gesichtserkennung kann man sich weitgehend verlassen, denn bis auf kleine Ausreißer werden alle Gesichter und den jeweiligen Personen zugeordnet – zumindest habe ich noch nie gegenteiliges gehört. Jetzt zeigt sich bei ersten Nutzern, dass das Gesicht dafür gar nicht mehr unbedingt vollständig sichtbar sein muss, sodass selbst Personen erkannt werden, die mit dem Rücken zur Kamera stehen. Auf den Beispielbildern weiter unten in diesem Artikel könnt ihr das sehr gut sehen.

Die Algorithmen erkennen erste Personen vollautomatisch oder bieten andere zum Hinzufügen an, wobei zumindest in den bekannten Testläufen die richtige Person vorgeschlagen wurde. Es ist unstrittig, dass das Gesicht nicht einmal annähernd zu sehen ist und somit auch nicht die Gesichtserkennung zum Einsatz kommen kann, die häufig auch von der Seite fotografierte Personen erkennen kann. Stattdessen müsse die Algorithmen andere Signale verwenden, die auf den Bildern zu sehen sind oder die sich in den Metadaten der Aufnahmen befinden.

Die Bilder haben gemeinsam, dass nicht nur die Person selbst sichtbar ist, sondern auch Teile der Bekleidung und dass alle Bilder, von hinten und von vorn, am selben Tag und in etwa am gleichen Ort aufgenommen worden sind. Und das reicht dann wohl für die Algorithmen aus, um die einzelnen Personen zuverlässig zuzuordnen.

Die Algorithmen können nicht nur Personen, sondern auch zusammenhängende Bilder erkennen. Und somit reicht es dann wohl auch, wenn bei einer Person neben dem Gesicht auch andere Merkmale sichtbar sind. Das könnte die Kleidung sein, vielleicht die Haarfarbe oder möglicherweise auch die Kopfform – so genau lässt sich das nicht sagen. Und so die meisten Menschen viele bekannte Personen von hinten erkennen können, können das nun auch bei ersten Nutzern die Algorithmen.

Google hat diese neue Fähigkeit mittlerweile bestätigt, aber weder offiziell angekündigt noch im Detail beschrieben. Vielleicht folgt das im Laufe der nächsten Tage.

» Google News: Zwei neue Widgets für die Android-App kommen – bringen Schlagzeilen auf den Homescreen

Letzte Aktualisierung am 2025-12-01 / Bilder von der Amazon Product Advertising API / Affiliate Links, vielen Dank für eure Unterstützung! Als Amazon-Partner verdiene ich an qualifizierten Verkäufen.

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter

Ist das tatsächlich eine optische Erkennung?

Viel einfacher ist doch die Zuordnung über den Standort: mit einer recht hohen Wahrscheinlichkeit sind sowohl der Standort des Fotografen als auch der des Fotografierten Google bekannt, die Richtung, in die die Kamera gehalten wurde auch – zack, kann daraus abgeleitet werden, wer im Bild zu sehen ist.

Das sind sicherlich zusätzliche Signale, aber die Person ist ja unterwegs und hat somit einen veränderten Standort und die Kamera einen anderen Blickwinkel. Und was ist, wenn man mit mehreren Personen unterwegs ist? 🙂

Das ist bei mir schon seit vielen Monaten so, erstmalig vor ca. 3 Jahren (!), als die App meinen damaligen Freund von hinten erkannt hat; aber damals nur in Ausnahmefällen. Seit ein paar Monaten/Wochen allerdings regelmäßig mit diversen Personen. War ich Tester, ohne es zu wissen?

Du nutzt Google, also ja!

Komisch, bei mir wurden ab Februar 2020 keine Personen mehr erkannt (weder von vorne noch von hinten)…