Künstliche Intelligenz: Neues Google-Projekt generiert überraschend realistische Bilder aus Text – in Rekordzeit

Google beschäftigt sich seit vielen Jahren mit intelligenter Bilderkennung und hat schon seit langer Zeit starke Algorithmen im Einsatz, die Bildinhalte recht genau beschreiben können. Mit einer Reihe von Tools und Künstlicher Intelligenz will man diesen Prozess umdrehen und stattdessen Bilder aus Texteingaben erzeugen. Kürzlich wurde ein neues Projekt vorgestellt, das vor allem mit Effizienz glänzen soll.

Die Bildmanipulation und Bilderzeugung wird durch Künstliche Intelligenz auf eine ganz neue Stufe gehoben und spielt auch bei Google eine immer größere Rolle. Mit Imagen und Parti hat man schon vor längerer Zeit intelligente Bildgeneratoren vorgestellt, selbst bei der Fotoplattform Google Fotos entwickelt es sich mit den magischen Funktionen in diese Richtung und vor wenigen Tagen wurde ein weiteres Projekt vorgestellt.

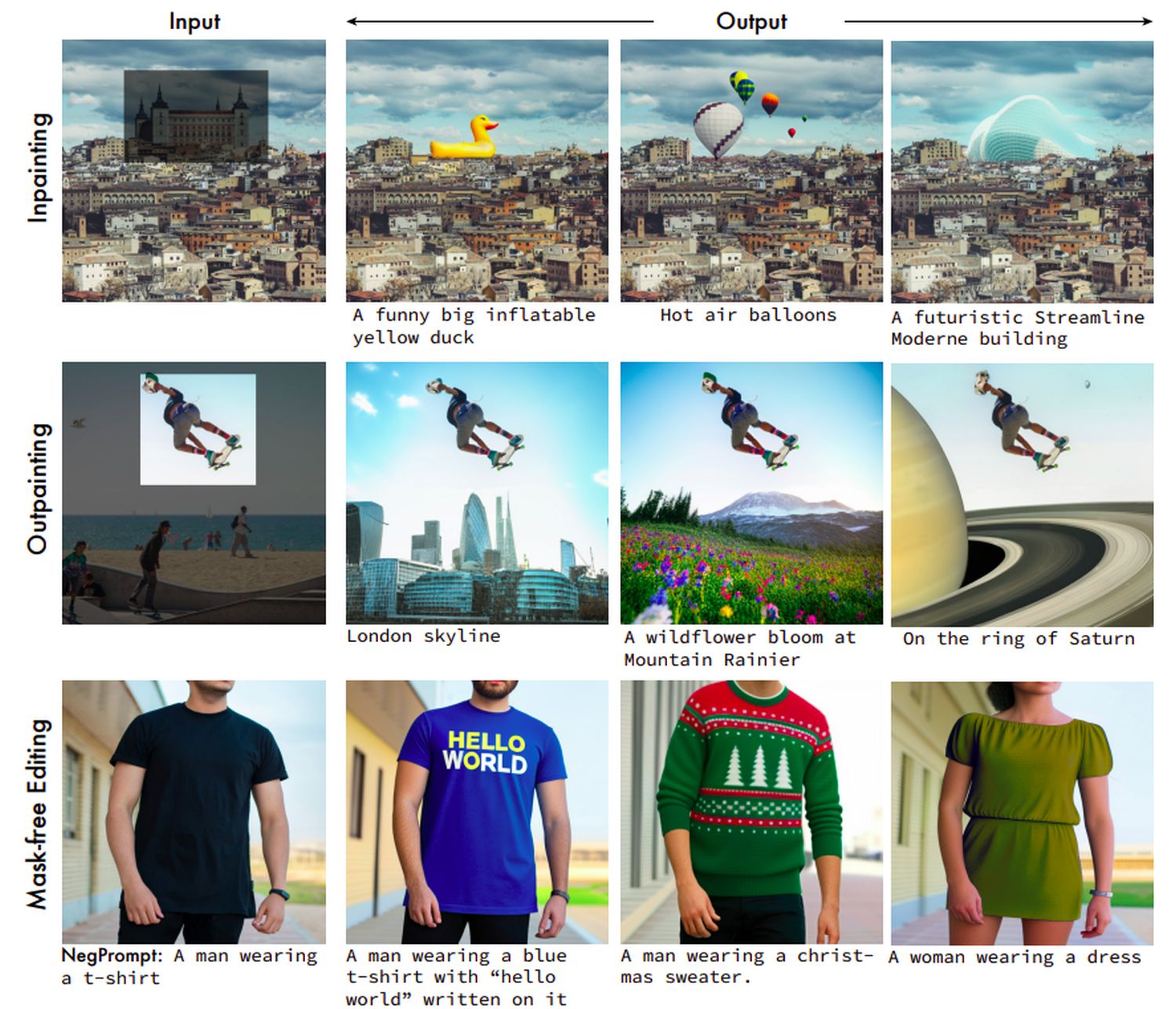

Google hat kürzlich Muse vorgestellt, das so wie Imagen und Parti oder auch das von OpenAI angebotene DALL-E darauf basiert, aus Texteingaben bzw. Bildbeschreibungen ein mehr oder weniger realistisch wirkendes Bild zu erzeugen. Das Projekt unterscheidet sich vor allem durch Performance und Effizienz von den anderen Projekten, denn während beispielsweise Parti oder Imagen 6 bis 9 Sekunden zur Erzeugung eines einzigen Bildes benötigen, sind es bei Muse gerade einmal 0,5 Sekunden.

Für Endnutzer spielt die Zeit keine große Rolle, auch wenn man natürlich lieber 0,5 als 9 Sekunden wartet. Sehr viel wichtiger ist es im breiten Einsatz, bei der Bildbearbeitung, bei der Erstellung ganzer Szenen oder auch der automatischen Generierung von Videos – was man ebenfalls bereits mit ersten Beispielen gezeigt hat.

Muse erreicht diese hohe Geschwindigkeit dadurch, dass man nicht mehr Pixel für Pixel „denkt“, sondern Token-basiert. Statt ganze Bilder aus dem Nichts zu generieren, werden bestehende Aufnahmen durchsucht und miteinander kombiniert. Dafür ist eine umfangreiche Bilderkennung und Objektbeschreibung notwendig, die alle Bilder sehr detailliert beschreibt, Positionen von Objekten kennt und die Fotos auswerten kann. Das klingt dann mehr nach Photoshop als nach künstlicher Kreativität, aber welche Photoshop-Künstler kann so etwa in einer halben Sekunden schaffen und zuvor noch die Bilder zusammensuchen?

Ich denke, dass der Muse-Ansatz zwar am wenigsten beeindruckend, dafür aber am vielversprechendsten ist. Denn durch das Zusammenfügen realer Bilder erreicht man auch ein reales Ergebnis – wenn auch mit abstrakten Inhalten. Aber die Inhalte werden durch den Nutzer bestimmt und wenn dann noch die Geschwindigkeit stimmt, ist es doch ein starkes Tool.

Mittlerweile hat Google also mindestens drei solcher Bildgeneratoren in der Entwicklung, die allesamt etwas unterschiedlich funktionieren. Aufgrund der aktuellen Entwicklung wird man wohl nicht mehr lange drumherum kommen, diese auch zu veröffentlichen und wenigstens eingeschränkt ersten Nutzern anzubieten. Erst vor wenigen Tagen wurde der Einsatz für dynamische Pixel-Wallpaper bekannt.

» Muse

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter