NIMA: Neues Google-Projekt bewertet die Qualität und Ästhetik von Fotos

Google hat schon seit Jahren eine sehr große Expertise in der Bilderkennung und verwendet diese in den unterschiedlichsten Anwendungen. Bekannt sind vor allem die diversen Tools zur Erkennung von Objekten in Bildern, aber das ist ja bekanntlich nur die halbe Miete. Jetzt hat Google Research ein neues System vorgestellt, das sich die reinen Bilder vornimmt und die Qualität bewertet – und das mit einer hohen Trefferquote.

In den letzten Jahren konzentriert sich bei Google alles darauf, Künstliche Intelligenzen auf alle denkbaren Aufgabengebiete anzusetzen und so viele Prozesse zu optimieren. Das funktioniert insbesondere bei der Bilderkennung schon sehr gut und sorgt dafür, dass Google Photos Bilder automatisch sortieren kann, die Websuche auch nach Bildinhalt sucht und Tools wie Google Lens überhaupt erst möglich macht. Aber es geht ja nicht immer nur um die Objekte auf dem Bild, sondern häufig auch um das Bild selbst.

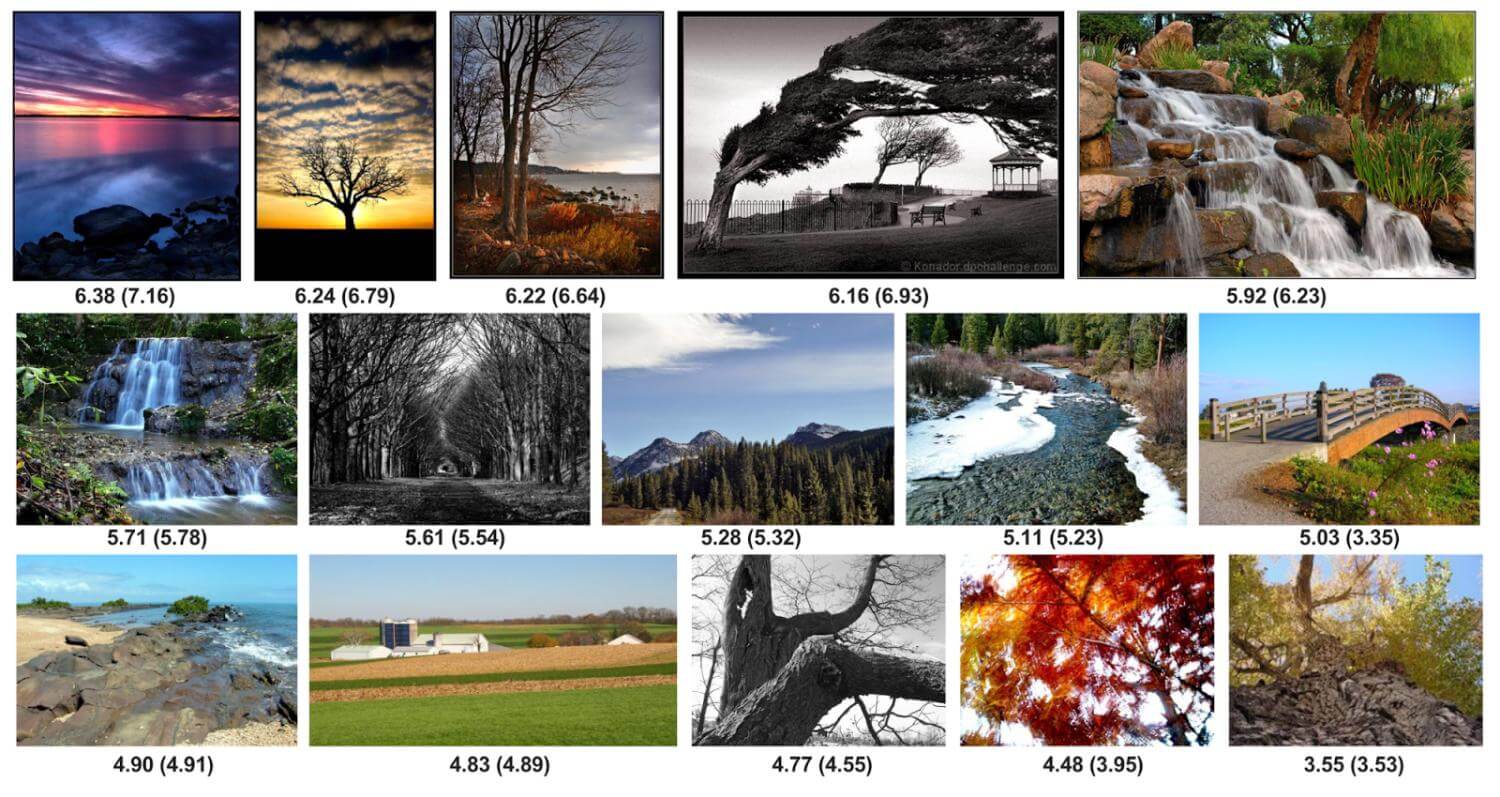

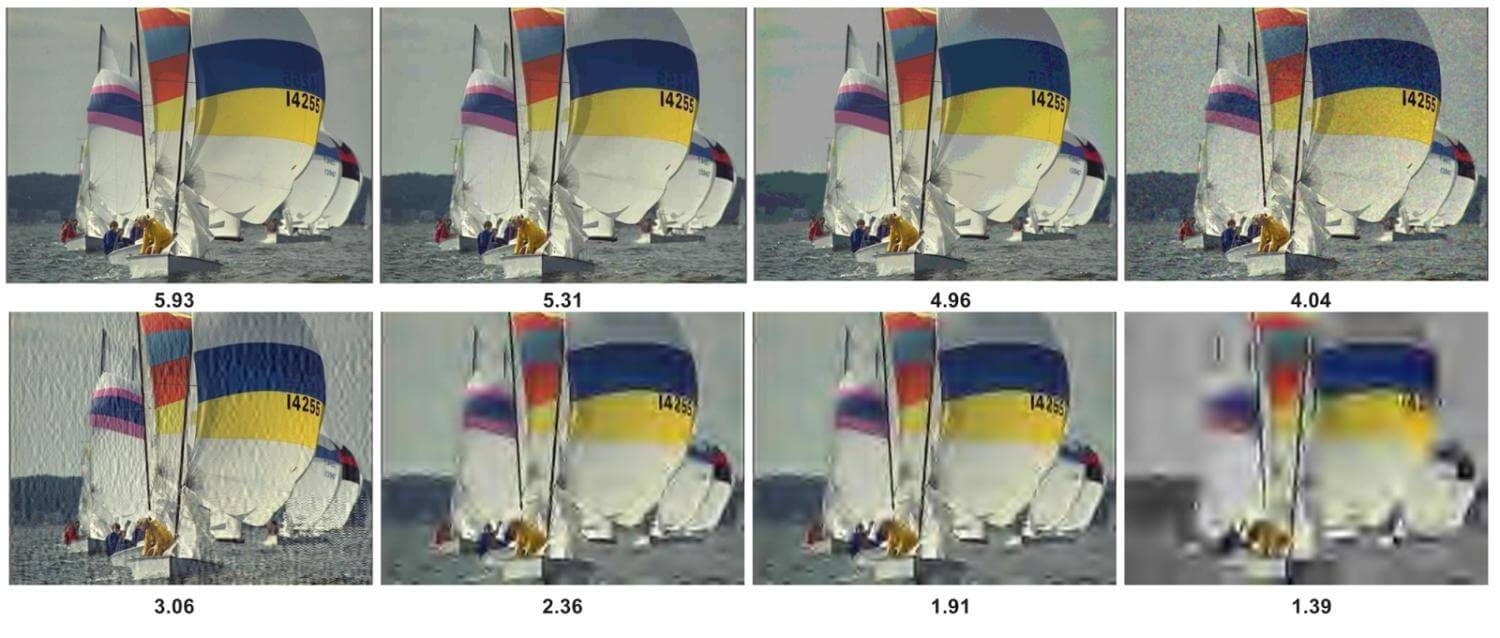

Jetzt hat Google ein neues System namens NIMA vorgestellt, dass sich mit der Erkennung und Bewertung von Bildern beschäftigt. NIMA steht für „Neural Image Assessment“ und besteht aus einem neuronalen Netz, das lernfähig ist. Die Aufgabe dieses System ist es, Bilder nach ihrer Qualität und Ästhetik einzustufen und eine entsprechende Wertung auf einer Skala von 0 bis 10 abzugeben. Und das macht das System sehr gut, wie auf obigem und folgendem Screenshot zu sehen ist.

Der erste Wert gibt den von NIMA ermittelten Wert an, während die Zahl in Klammern den Wert einer Datenbank angibt, die von Menschen angelegt und natürlich auch bewertet wurde. Einiges ist natürlich Geschmacksache, aber neutral bewertet sind die Wert relativ nah beieinander. Grundlegend wertet NIMA unter anderem die Schärfe oder eventuelle Verzerrungen aus, basiert aber auch auf vielen anderen Faktoren. Details dazu findet ihr im Google Research-Blog.

Ein Einsatzgebiet für NIMA gibt es derzeit noch nicht, es könnte aber unter anderem dazu verwendet werden, aus einer Serie von Bildern oder automatischen Verbesserungen das beste Foto auszuwählen. Dazu sind die Algorithmen schon heute sehr gut in der Lage, könnten aber in Zukunft noch besser darin werden.

» Ankündigung im Google Research-Blog

[heise]

GoogleWatchBlog bei Google News abonnieren | GoogleWatchBlog-Newsletter

Darüber, mit welchem Maßstab man Ästhetik misst, haben sich schon viele Philosophen den Kopf zerbrochen (z. B. David Hume – Über die Regel des Geschmacks) und sind dabei nicht weitergekommen. Zum Glück hat Google das jetzt geschafft!

Die Regeln der Ästhetik sind schon uralt und stammen teilweise sogar schon von den

alten antiken Griechen und folgen mathematischen Regeln/Konstanten (z.B. Goldener Schnitt)

Und was kaum einer weiss….vom Dichterfürsten Johann Wolfgang von Goethe stammt die

Farbenlehre.

Und auch Johann Sebastian Bach hat seine Musik größtenteils nach den Regeln der Mathematik

komponiert…..

Kurz:

Ästhetik ist nichts mythisch philosophisches….sondern etwas wissenschaftlich, mathematisches

Und das kann man in Computern durchaus berechnen.

Das würde bedeuten, dass es die eine Schönheit/Ästhetik gibt. Davon ausgehend, dass die Geschmäcker aber verschieden sind: Welcher der zwei (drei, vier…) Geschmäcker ist dann aber der „hochwertigere“? Diesen kann man mit Mathematik berechnen? Würde das dann nicht heißen, dass jegliche Streiterei über guten und schlechten Geschmack obsolet ist (und zwar schon seit den alten Griechen)?